人工智慧(AI)發展普及化,甚至可透過AI軟體大玩「換臉」,大陸因此興起地下黑產業,開始透過AI軟體將明星的臉,轉植合成為「DeepFake」色情影片,在百度貼吧、閒魚等網路平台販售,喊出如158元(人民幣,下同)打包購買700部影片,甚至還可傳送私人照片換臉的客製化服務。

事實上,大陸類似AI換臉事件並非新鮮事,過去多數用於網路惡搞影片,例如年初就有人將《射雕英雄傳》當中朱茵替換成楊冪的影片引起熱議。但卻逐步演化地下產業。網路專家指出,在大陸售賣AI換臉色情影片,本身觸犯傳播淫穢物品牟利罪,同時也侵犯肖像權;買家購買後再傳播牟利也可能構成違法。

一鍵脫衣APP也紅火

所謂「Deepfake」指的是用AI軟體製作的假影片,主要透過FakeApp製作而成當中FakeApp可實現AI換臉,另一軟體DeepNude則能夠過AI將照片人物達到「一鍵脫衣」的效果。

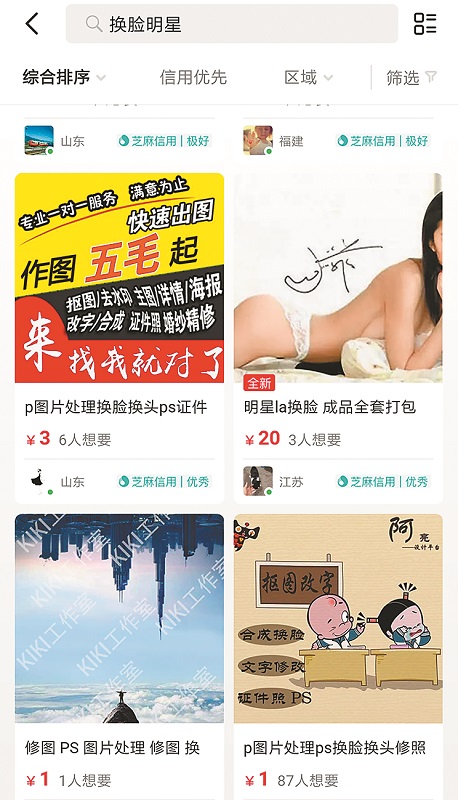

據《新京報》近日調查,隨著AI技術門檻降低,售賣明星換臉的色情影片已成為地下生意,搜尋百度貼吧例如「換臉」、「Deepfake」或「FakeApp」等,不乏出現標榜「換臉+女明星姓名」的發帖者,售賣換臉合成的色情影片,價格喊出4元1部,或有158元打包購買700部影片。

而陸媒聯繫到線上賣家,隨後發來「80部明星合成視頻清單」的壓縮檔,包含多部色情影片的列表截圖,檔案名上更標注出多位大眾熟知的女明星。

偽造證件詐騙不少

在近期受到大眾關注後,雖然部分已被下架,但在閒魚二手平台上,還有賣家提供「訂製換臉」服務,只要買家提供明星或私人照片,即可將色情影片中的主角移花接木,價格開出1分鐘20到50元不等,且提供照片張數越多、角度越多號稱越真實。

實際上這類黑產業的隱患不只色情影片,甚至還有假造證件與詐騙風險。也有線上賣家默認過曾有人要求製售假證件;大陸法學人士說,這可能被用於電信詐騙,例如通過換臉詐取錢財,就算不成功,也可能造成當事人名譽損害。(記者/吳泓勳)